Si tenés dos minutos, esto es lo que tenés que saber:

- Para identificar imágenes generadas por Inteligencia Artificial (IA), es importante realizar una búsqueda inversa para reconocer la fuente de la imagen y si fue publicada anteriormente. También se recomienda mirar las manos, ojos, orejas, sombras, rostros desenfocados y detalles de contexto para encontrar imperfecciones y errores anatómicos.

- Con deepfakes, que son videos generados con inteligencia artificial, es esencial hacer foco en los movimientos del cuerpo de las personas e identificar si el sonido de la voz está en sincronía con los movimientos de la boca, un error común de estas tecnologías. Además de tener los mismos cuidados que con las imágenes generadas por IA.

- El debate sobre cómo detectar imágenes realizadas con IA se intensificó en abril de 2023, cuando se viralizaron imágenes del Papa Francisco con un abrigo blanco y una serie de fotografías de Donald Trump arrestado.

- Pablo M. Fernández, director ejecutivo y periodístico de Chequeado, medio argentino especializado en factchecking y desinformación, advierte que los errores que hasta ahora posibilitan verificar la veracidad de las imágenes y videos generados o manipulados con IA, pronto serán solucionados. En el futuro se volverá más difícil identificarlos.

Si tenés más tiempo, te invitamos a leer todo el artículo:

El 16 de mayo de 2023, Stilber Valdez, excandidato a la vicepresidencia por Cruzada Nacional, dijo que un video en el que Paraguayo Cubas insta a indígenas a retirarse de la movilización frente al Tribunal Superior de Justicia Electoral (TSJE) fue hecho con inteligencia artificial. El comandante de la Policía Nacional, Gilberto Fleitas, desmintió esto y afirmó que el video fue grabado bajo su autorización en la Agrupación Especializada, donde Cubas se encuentra recluido.

Ya en marzo de este año, las imágenes del Papa Francisco con una chaqueta blanca o de Donald Trump siendo arrestado intensificaron la discusión pública sobre cómo distinguir cuando una imagen es generada por IA. También los deepfakes de Barak Obama, expresidente de Estados Unidos, o del presidente ucraniano Volodymyr Zelensky, irrumpieron internet y sacaron a luz cómo este tipo de contenidos pueden engañar y hacer daño.

Según Microsoft, la IA es “la capacidad de un sistema informático de imitar funciones cognitivas humanas, como el aprendizaje y la solución de problemas”. Para Google, la Inteligencia Artificial es un conjunto de tecnologías que permiten que las computadoras realicen varias funciones avanzadas, “incluida la capacidad de ver, comprender y traducir lenguaje hablado y escrito, analizar datos, hacer recomendaciones y mucho más”.

Pablo M. Fernández, en entrevista para La Precisa, dijo que el uso de imágenes generadas por IA “es algo que existe, que seguramente se va a volver más fácil de usar para realizar algo positivo y también para algo negativo. Nosotros, los medios especializados en verificación, tenemos que ir aprendiendo a la par”.

A continuación presentamos una breve guía para detectar imágenes y videos generados por IA:

Cómo identificar imágenes generadas con IA

1. Verificá las fuentes

¿La imagen tiene crédito? ¿Podemos identificar a los responsables? Diferentes medios especializados en factchecking y desinformación, como Chequeado, Mala Espina, Aos Fatos y Animal Político, recomiendan buscar la fuente de la imagen.

Una de las herramientas para identificar el origen del contenido es la búsqueda inversa de imagen de Google. Con esto se puede rastrear dónde ha circulado el contenido, el origen de su distribución y quién generó la imagen con IA.

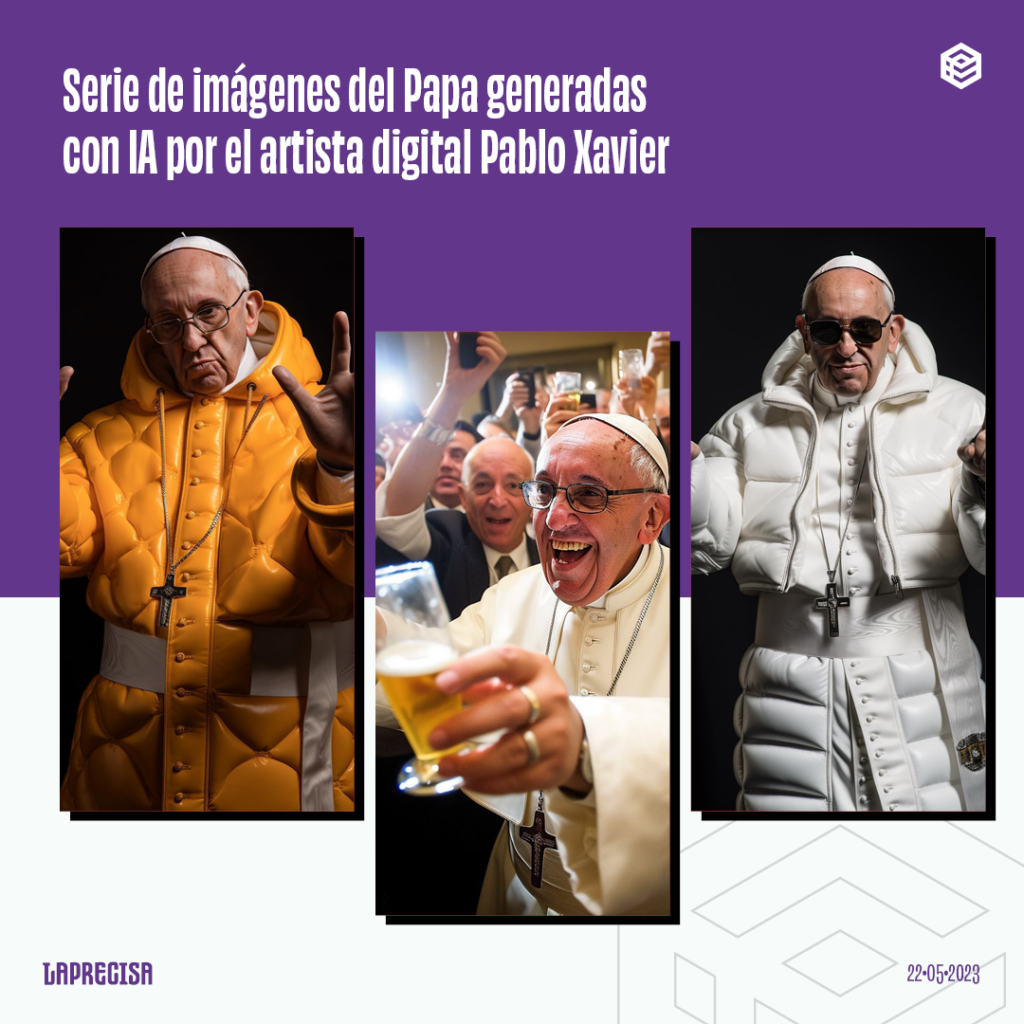

La imagen del Papa Francisco con una chaqueta blanca fue publicada por el artista digital Pablo Xavier el 24 de marzo en una comunidad de Reddit destinada a compartir imágenes producidas con Midjourney, una plataforma que funciona a través de Discord.

2. En los detalles puede estar el error

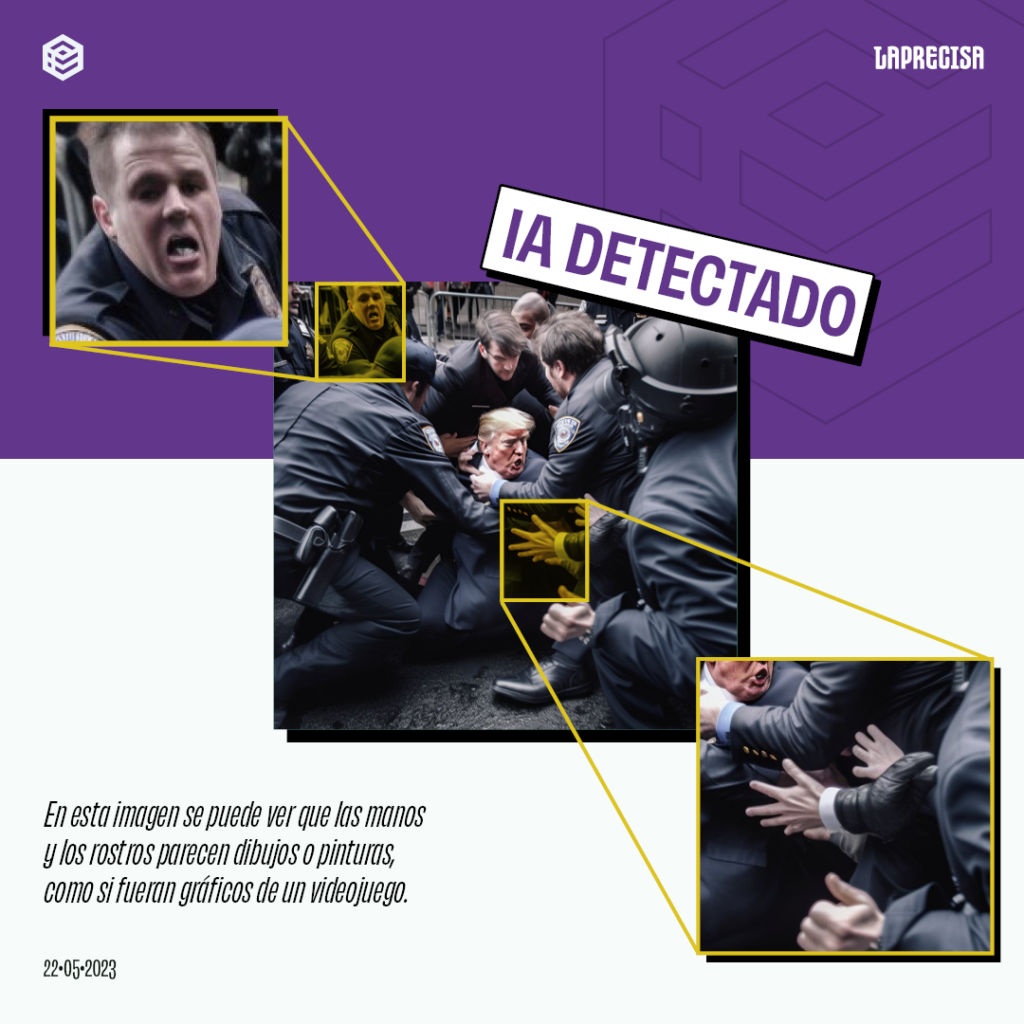

Según Chequeado, una de las inconsistencias que aún tienen las IA al generar imágenes de ser humanos son las manos. ¿Tienen 5 dedos? ¿La posición es anatómicamente posible? Si ataja algún objeto, ¿es la manera habitual de hacerlo? Si lo hiciéramos, ¿se caería el objeto? Estas son algunas preguntas que podemos hacernos para detectar si la imagen es real o no.

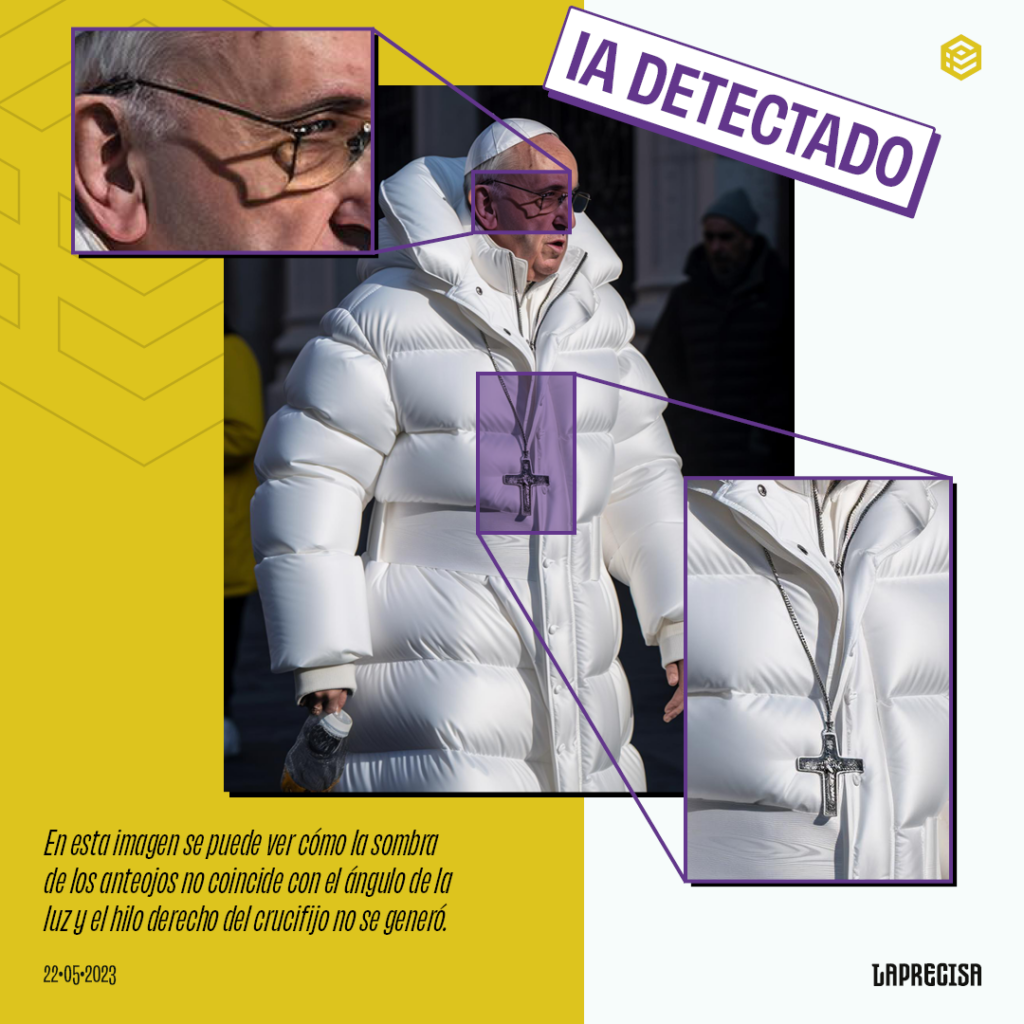

Otra parte del cuerpo humano que las IA aún no han perfeccionado son los ojos. Muchas veces los ojos salen borrosos, tienen una expresión no habitual o son amorfos. En caso que el protagonista de la imagen tenga anteojos, pueden haber inconsistencias en los reflejos del vidrio o en la sombra proyectada por los anteojos.

El rostro y la textura de la piel de las personas también se pueden ver muy sintéticas o artificiales. Las orejas, dientes y el cabello suelen tener errores de simetría, morfología o tener un aspecto digital, más aún si son parte del contexto o no son el objeto principal en la composición.

3. Buscá inconsistencias de las imágenes

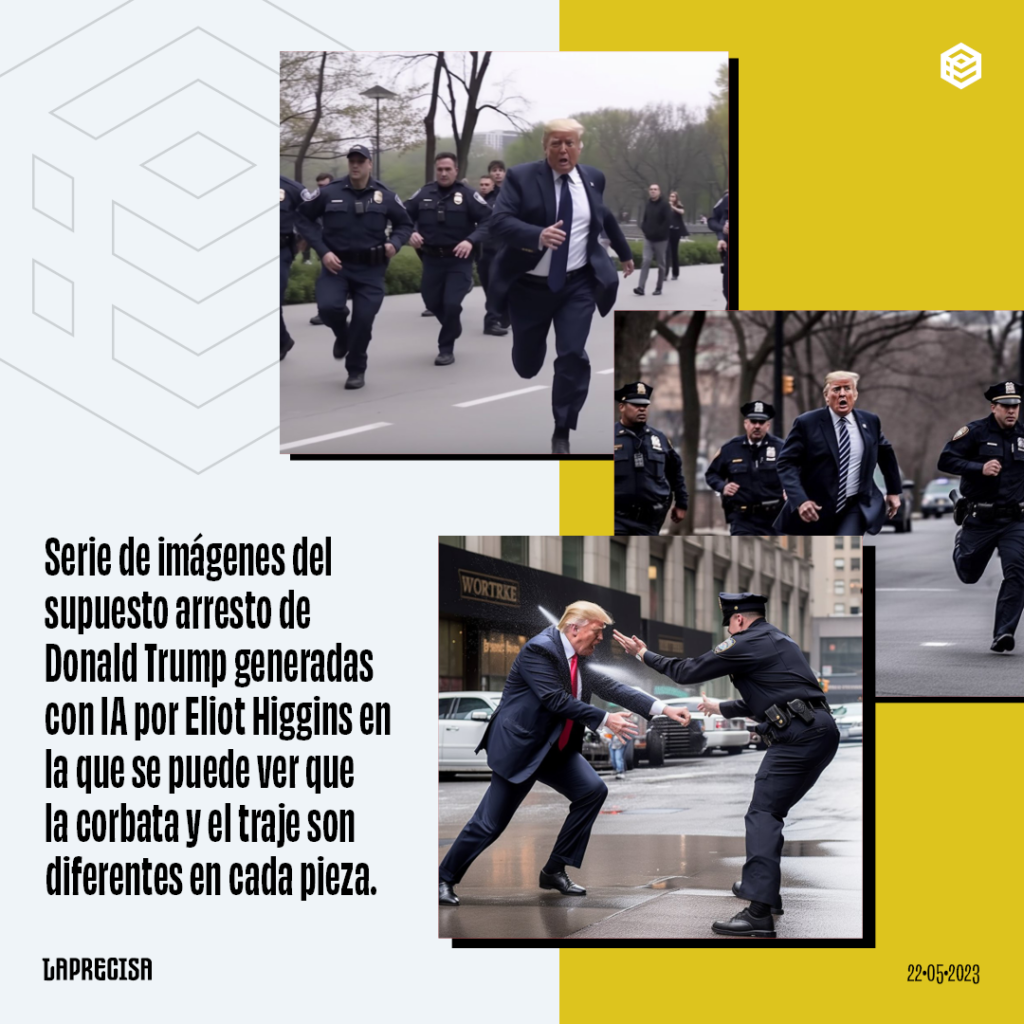

Aunque pocas personas saben, la fotografía del Papa Francisco es parte de una serie de imágenes realizadas por el artista digital Pablo Xavier. Las imágenes de Donald Trump siendo apresado se encuentran en un hilo de Twitter de Eliot Higgins, autor de las composiciones hechas con IA.

Entre las imágenes del Papa se puede ver que los abrigos son diferentes, en sus dedos tiene distintos anillos o el crucifijo en su pecho es otro. Además, el artista subió más de una composición hecha con IA del Papa como protagonista, como en la que se lo ve con un abrigo naranja o tomando cerveza.

En el caso de las imágenes sobre Donald Trump, se publicaron como si fueran registros de una persecución, resistencia y arresto del expresidente de Estados Unidos. Un artículo de Univisión expone como en la serie de imágenes se puede ver que la corbata y el traje de Trump son diferentes en las imágenes, además de las otras inconsistencias ya analizadas.

Cómo identificar un deepfake o un video manipulado o generado con IA

Un deepfake tiene como objetivo sustituir rostros humanos en videos o audios a través de inteligencia artificial. Para hacerlo, analiza un banco de imágenes y sonidos proveídos por un usuario para encontrar patrones en los gestos de un rostro y generar el video. A menudo, este tipo de contenidos tiene un tono humorístico en las redes sociales, aunque también se utiliza para realizar videos pornográficos falsos.

Además de los cuidados que se deben tener para rastrear y reconocer imágenes generadas con IA, para detectar deepfakes debemos fijarnos en otros detalles.

El MIT Media Lab, laboratorio del Instituto de Tecnología de Massachusetts, propone un conjunto de preguntas clave para identificar deepfakes:

Prestar atención a los gestos, movimientos y detalles del rostro y preguntarse lo siguiente: ¿Los movimientos de la boca están sincronizados con el audio o se ven naturales? ¿La persona parpadea lo suficiente o demasiado? ¿La piel se ve demasiado suave o arrugada? ¿Es similar el envejecimiento de la piel y el cabello? ¿El vello facial y el cabello parecen reales?

Fijate en las sombras y luces del video: ¿Las sombras coinciden con el ángulo de la luz? ¿Si la persona tiene gafas, hay reflejos? ¿Cambia el ángulo del reflejo si la persona se mueve? ¿Hay brillo en los ojos del protagonista del video?